DPU của NVIDIA đang nổi lên như một giải pháp đột phá trong việc xử lý dữ liệu mạng, bảo mật và lưu trữ. Bài viết này sẽ giúp bạn hiểu rõ vai trò, ưu điểm và tiềm năng tương lai của DPU trong hệ sinh thái công nghệ.

1. DPU là gì?

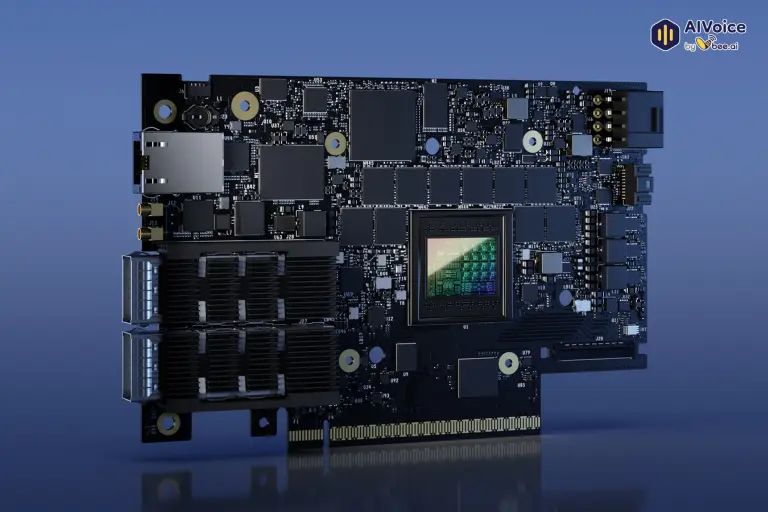

DPU (Data Processing Unit) là một loại vi mạch chuyên dụng được thiết kế đặc biệt để xử lý khối lượng dữ liệu khổng lồ trong các hệ thống mạng và máy chủ hiện đại.

Những vai trò chính của DPU trong hệ thống hiện đại bao gồm:

- Tăng tốc độ truyền dữ liệu và giảm độ trễ: DPU xử lý các gói tin mạng với tốc độ cao, cải thiện đáng kể hiệu suất cho các ứng dụng đòi hỏi độ trễ thấp.

- Nâng cao an ninh mạng: DPU cung cấp khả năng bảo mật ở cấp độ phần cứng, bao gồm mã hóa, tường lửa và phát hiện xâm nhập.

- Tối ưu hóa ảo hóa: DPU có thể quản lý các tác vụ ảo hóa mạng, giúp cải thiện hiệu suất trong môi trường đám mây và trung tâm dữ liệu.

- Xử lý dữ liệu thông minh: DPU thực hiện phân tích và xử lý dữ liệu trước khi chuyển đến CPU, giúp lọc và tổ chức thông tin hiệu quả hơn.

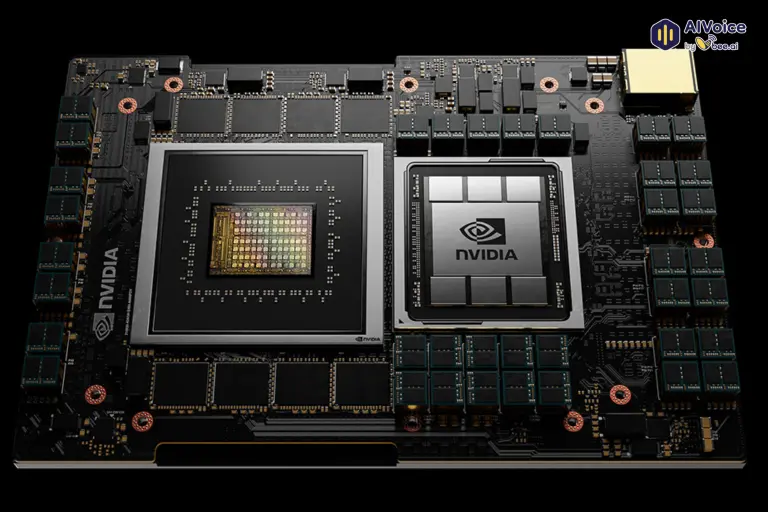

2. DPU của NVIDIA có gì nổi bật?

NVIDIA, công ty nổi tiếng với các giải pháp GPU hàng đầu thế giới, đã mở rộng danh mục sản phẩm của mình với dòng DPU (Data Processing Unit) đột phá. DPU của NVIDIA được thiết kế để đáp ứng những thách thức ngày càng phức tạp trong việc xử lý dữ liệu quy mô lớn tại các trung tâm dữ liệu hiện đại.

Điểm nổi bật của DPU NVIDIA là khả năng tích hợp cả phần cứng chuyên dụng và nền tảng phần mềm mạnh mẽ, tạo nên một giải pháp toàn diện cho việc xử lý dữ liệu. So với các giải pháp truyền thống, DPU của NVIDIA mang đến cải tiến vượt bậc về hiệu suất, khả năng mở rộng và bảo mật.

2.1 Các sản phẩm DPU của NVIDIA

NVIDIA BlueField-2 DPU:

- Tích hợp 8 lõi Arm A72 với tốc độ lên đến 2.5GHz

- Hỗ trợ kết nối mạng lên đến 2×100/200Gb/s

- Tăng tốc mạng, bảo mật và lưu trữ

- Công nghệ ConnectX-6 Dx cho hiệu suất mạng đỉnh cao

- Xử lý mã hóa và giải mã ở cấp độ phần cứng

NVIDIA BlueField-3 DPU:

- Hiệu suất cao hơn 10 lần so với BlueField-2

- 16 lõi Arm A78 mạnh mẽ

- Hỗ trợ kết nối đến 400Gb/s

- Khả năng bảo mật mạnh mẽ với tính năng zero-trust security

- Tối ưu hóa cho AI và phân tích dữ liệu trên mạng

NVIDIA BlueField-4 DPU:

- Tích hợp khả năng xử lý AI và tăng tốc GPU

- Hiệu suất cao hơn gấp nhiều lần so với thế hệ trước

- Thiết kế đặc biệt cho môi trường điện toán đám mây và siêu máy tính

- Hỗ trợ tiêu chuẩn mạng thế hệ mới

- Bảo mật nâng cao với khả năng phát hiện mối đe dọa thời gian thực

2.2 Đặc điểm nổi bật của DPU NVIDIA

Hiệu suất tính toán vượt trội:

- Kết hợp các lõi xử lý Arm hiệu năng cao với bộ tăng tốc phần cứng chuyên dụng

- Khả năng xử lý song song hàng triệu gói tin mạng

- Giảm độ trễ và tăng thông lượng dữ liệu đáng kể

Kiến trúc lập trình linh hoạt:

- Hỗ trợ DOCA (Data-Center-on-a-Chip Architecture) – nền tảng phần mềm để phát triển ứng dụng trên DPU

- Môi trường phát triển mở cho phép tùy chỉnh các chức năng xử lý dữ liệu

- Hệ sinh thái SDK phong phú để tối ưu hóa cho từng trường hợp sử dụng

Giảm tải hiệu quả cho CPU/GPU:

- Tiếp nhận hoàn toàn các tác vụ liên quan đến mạng và bảo mật

- Giải phóng đến 30% tài nguyên CPU cho các ứng dụng chính

- Giảm độ phức tạp trong việc quản lý luồng dữ liệu

Bảo mật tích hợp mạnh mẽ:

- Tính năng bảo mật phần cứng trong từng DPU

- Cô lập các môi trường ảo hóa vào các miền bảo mật riêng biệt

- Phát hiện và ngăn chặn mối đe dọa trước khi chúng tiếp cận hệ thống chính

Hệ sinh thái phần mềm toàn diện:

- Hỗ trợ các giải pháp phần mềm NVIDIA Morpheus, DOCA và NVIDIA AI Enterprise

- Tích hợp với các nền tảng ảo hóa phổ biến như VMware, Kubernetes

- Công cụ quản lý và giám sát toàn diện

Điểm khác biệt quan trọng của DPU NVIDIA là cách tiếp cận “hệ thống hoàn chỉnh”, trong đó mỗi DPU không chỉ là một thành phần phần cứng đơn thuần mà là một nền tảng xử lý dữ liệu toàn diện với phần mềm đi kèm được thiết kế đặc biệt để tối ưu hóa hiệu suất và tính linh hoạt.

3. Ứng dụng của DPU NVIDIA trong các ngành công nghiệp

3.1 Trí tuệ nhân tạo và máy học

Trong lĩnh vực trí tuệ nhân tạo và máy học, DPU của NVIDIA đóng vai trò quan trọng trong việc tối ưu hóa toàn bộ quy trình xử lý dữ liệu – từ thu thập, tiền xử lý đến huấn luyện và triển khai mô hình. Những ứng dụng cụ thể bao gồm:

Tăng tốc luồng dữ liệu AI:

- Xử lý và nén dữ liệu đầu vào trước khi chuyển đến GPU để huấn luyện

- Giảm thời gian chờ dữ liệu (data waiting time), giúp tận dụng tối đa hiệu suất GPU

- Cải thiện tốc độ huấn luyện mô hình lên đến 30% trong một số trường hợp

Tối ưu hóa triển khai AI:

- Hỗ trợ suy luận (inference) AI với độ trễ thấp thông qua việc tối ưu hóa đường dẫn dữ liệu

- Xử lý phân tán cho các mô hình lớn trên nhiều nút tính toán

- Cân bằng tải thông minh cho các yêu cầu suy luận AI

Bảo mật cho hệ thống AI:

- Bảo vệ mô hình AI và dữ liệu nhạy cảm khỏi các cuộc tấn công

- Mã hóa dữ liệu trong quá trình huấn luyện phân tán

- Kiểm soát truy cập dựa trên vai trò cho các tài nguyên AI

3.2 Mạng và trung tâm dữ liệu

Trong lĩnh vực mạng và trung tâm dữ liệu, DPU của NVIDIA đã tạo ra một cuộc cách mạng về cách xây dựng và vận hành hạ tầng số. Với khả năng tiếp quản hoàn toàn các chức năng mạng từ CPU, DPU đã trở thành thành phần quan trọng trong kiến trúc trung tâm dữ liệu hiện đại:

Ảo hóa mạng hiệu suất cao:

- Cung cấp khả năng ảo hóa mạng không ảnh hưởng đến hiệu suất (zero-overhead)

- Hỗ trợ SR-IOV (Single Root I/O Virtualization) và các công nghệ ảo hóa mạng hiện đại

- Quản lý overlay network với chi phí CPU tối thiểu

Tăng tốc đáng kể cho SDN (Software-Defined Networking):

- Xử lý các chức năng mạng ảo hóa (NFV) trực tiếp trên DPU thay vì CPU

- Tối ưu hóa hiệu suất cho các ứng dụng sử dụng nhiều băng thông như lưu trữ phân tán

- Giảm độ trễ mạng thông qua việc xử lý gói tin hiệu quả hơn

Quản lý lưu lượng thông minh:

- Giám sát và phân tích lưu lượng mạng theo thời gian thực

- Triển khai QoS (Quality of Service) cho các ứng dụng ưu tiên

- Cân bằng tải thích ứng dựa trên tình trạng mạng và ứng dụng

Mạng lưu trữ tích hợp:

- Tăng tốc giao thức NVMe-oF (NVMe over Fabrics) cho lưu trữ hiệu suất cao

- Xử lý RDMA (Remote Direct Memory Access) để giảm độ trễ truy cập lưu trữ

- Tối ưu hóa hiệu suất cho các giải pháp lưu trữ phân tán như Ceph và HDFS

3.3 An ninh mạng và bảo mật

DPU của NVIDIA đang định hình lại cách thức các tổ chức tiếp cận vấn đề bảo mật mạng thông qua việc tích hợp các tính năng bảo mật mạnh mẽ ngay từ cấp độ phần cứng. Trong môi trường số ngày càng đối mặt với các mối đe dọa phức tạp, DPU cung cấp nhiều lớp bảo vệ:

Mã hóa hiệu suất cao:

- Khả năng mã hóa/giải mã dữ liệu với tốc độ lên đến hàng trăm Gbps

- Hỗ trợ đầy đủ các chuẩn mã hóa hiện đại (AES-GCM, ChaCha20-Poly1305)

- Mã hóa lưu lượng mạng theo thời gian thực mà không làm giảm hiệu suất

Phát hiện và ngăn chặn xâm nhập:

- Phân tích gói tin theo thời gian thực để phát hiện mẫu tấn công

- Deep packet inspection (DPI) với hiệu suất cao

- Ngăn chặn các cuộc tấn công DDoS và các mối đe dọa mạng khác trước khi chúng ảnh hưởng đến ứng dụng

Cô lập và phân đoạn mạng:

- Tạo các vùng mạng (network zones) cô lập về mặt vật lý

- Giới hạn phạm vi tác động của các xâm nhập tiềm ẩn

- Bảo vệ môi trường đa người thuê (multi-tenant) trong các trung tâm dữ liệu

Giám sát bảo mật liên tục:

- Thu thập và phân tích dữ liệu telemetry về các sự kiện bảo mật

- Phát hiện hành vi bất thường thông qua học máy

- Cảnh báo sớm về các mối đe dọa tiềm ẩn

4. Tại sao chọn DPU của NVIDIA?

4.1 Hiệu suất và khả năng mở rộng

Hiệu suất và khả năng mở rộng là hai yếu tố then chốt làm nên ưu thế vượt trội của các giải pháp DPU từ NVIDIA. Bằng cách tích hợp công nghệ tiên tiến và kiến trúc được tối ưu hóa, DPU NVIDIA cung cấp hiệu suất xử lý dữ liệu vượt trội:

Hiệu suất xử lý dữ liệu vượt trội:

- Tốc độ xử lý gói tin lên đến hàng triệu gói tin mỗi giây

- Băng thông mạng từ 100Gbps đến 400Gbps trên một thiết bị DPU

- Giảm độ trễ xử lý dữ liệu xuống mức micro giây

- Khả năng xử lý đồng thời nhiều luồng dữ liệu và ứng dụng

Tăng hiệu quả sử dụng tài nguyên hệ thống:

- Giảm tải cho CPU lên đến 30%, cho phép CPU tập trung vào các tác vụ tính toán quan trọng

- Tối ưu hóa hiệu suất I/O bằng cách xử lý các tác vụ liên quan đến dữ liệu ngay trên DPU

- Cải thiện thông lượng tổng thể của hệ thống trong các môi trường đa ứng dụng

Khả năng mở rộng linh hoạt:

- Kiến trúc có thể mở rộng từ các triển khai nhỏ đến siêu máy tính

- Hỗ trợ môi trường đa người thuê (multi-tenant) với hiệu suất nhất quán

- Khả năng nâng cấp phần mềm để thích ứng với các yêu cầu mới mà không cần thay đổi phần cứng

- Tích hợp liền mạch với các hệ thống hiện có

Hiệu suất trong các trường hợp sử dụng cụ thể:

- Tăng tốc đáng kể cho các cơ sở dữ liệu phân tán

- Giảm độ trễ cho các ứng dụng thời gian thực như dịch vụ tài chính

- Nâng cao hiệu suất cho các nền tảng phân tích dữ liệu lớn

4.2 Hỗ trợ kỹ thuật và cộng đồng người dùng

NVIDIA cung cấp một hệ sinh thái hỗ trợ mạnh mẽ cho người dùng DPU, giúp các doanh nghiệp tối đa hóa giá trị đầu tư vào công nghệ này. Sự kết hợp giữa hỗ trợ kỹ thuật chuyên nghiệp và cộng đồng người dùng sôi động tạo nên một môi trường lý tưởng để triển khai và quản lý DPU:

Hỗ trợ kỹ thuật chuyên nghiệp:

- Đội ngũ hỗ trợ kỹ thuật chuyên dụng với chuyên gia về DPU

- Dịch vụ hỗ trợ 24/7 cho các triển khai quan trọng

- Các gói hỗ trợ linh hoạt phù hợp với nhu cầu của từng doanh nghiệp

- Hỗ trợ triển khai và tối ưu hóa tùy chỉnh

Tài liệu và hướng dẫn phong phú:

- Tài liệu kỹ thuật toàn diện về kiến trúc DPU và ứng dụng

- Hướng dẫn triển khai chi tiết cho nhiều trường hợp sử dụng

- Mẫu mã nguồn và ví dụ để đẩy nhanh quá trình phát triển

- Cập nhật thường xuyên về các tính năng và khả năng mới

Cộng đồng người dùng sôi động:

- Diễn đàn NVIDIA Developer hỗ trợ thảo luận về DPU

- Nhóm người dùng NVIDIA DPU với các thành viên từ nhiều ngành

- Chia sẻ kinh nghiệm và các phương pháp hay nhất giữa các tổ chức

- Sự kiện và hội thảo trực tuyến thường xuyên về công nghệ DPU

Đào tạo và chứng chỉ:

- Chương trình đào tạo chuyên nghiệp về công nghệ DPU

- Khóa học trực tuyến cho kỹ sư và quản trị viên hệ thống

- Chứng chỉ NVIDIA cho người quản trị DPU

- Tài liệu hướng dẫn về việc tích hợp DPU vào hạ tầng hiện có

4.3 Tính năng tiên tiến và công nghệ độc quyền

NVIDIA đã tích hợp nhiều công nghệ độc quyền và tính năng tiên tiến vào các sản phẩm DPU của mình, tạo nên lợi thế cạnh tranh vững chắc trong thị trường xử lý dữ liệu. Những công nghệ độc đáo này mang đến các giải pháp vượt trội cho các thách thức phức tạp trong xử lý dữ liệu hiện đại:

Kiến trúc DOCA (Data Center on a Chip):

- Nền tảng phần mềm toàn diện giúp tận dụng tối đa khả năng của DPU

- Framework lập trình thống nhất cho phép phát triển ứng dụng chạy trên DPU

- Thư viện tối ưu hóa hiệu suất cho các chức năng xử lý dữ liệu phổ biến

- API mở cho phép tích hợp với các hệ thống và ứng dụng khác

Công nghệ ConnectX:

- Giao diện mạng hiệu suất cao với độ trễ cực thấp

- Offload hoàn toàn các chức năng mạng từ CPU

- Hỗ trợ RDMA, RoCE và các giao thức mạng hiệu suất cao khác

- Tối ưu hóa cho các ứng dụng high-performance computing

Bộ xử lý mạng NVIDIA Mellanox:

- Thiết kế chuyên dụng cho xử lý gói tin tốc độ cao

- Hash engine để định tuyến và phân loại gói tin hiệu quả

- Xử lý stateful flow offload cho hiệu suất cao hơn

- Tối ưu hóa cho các môi trường SDN và NFV

Zero Trust Security Architecture:

- Bảo mật ở cấp độ phần cứng với khu vực tin cậy được cô lập

- Mật mã học phần cứng cho mã hóa/giải mã hiệu suất cao

- Kiểm soát truy cập dựa trên vai trò ở cấp độ gói tin

- Khả năng phát hiện xâm nhập và phòng thủ trên DPU

GPU Direct RDMA:

- Truyền dữ liệu trực tiếp giữa DPU và GPU mà không cần qua CPU

- Giảm độ trễ truyền dữ liệu trong các ứng dụng AI/ML

- Tăng tốc đáng kể cho các ứng dụng đòi hỏi phối hợp GPU-DPU

- Tối ưu hóa hiệu suất cho các môi trường tính toán hiệu năng cao

NVIDIA ASAP2 (Accelerated Switch and Packet Processing):

- Tăng tốc xử lý gói tin và chuyển mạch trên DPU

- Giảm đáng kể độ trễ xử lý mạng

- Khả năng mở rộng linh hoạt cho các môi trường mạng phức tạp

- Hỗ trợ tính năng telemetry mạng cho giám sát hiệu suất

5. Tương lai của DPU trong xử lý dữ liệu

- Kết hợp với AI: DPU sẽ tích hợp AI chuyên dụng để xử lý và phân tích dữ liệu ngay tại mạng, hỗ trợ phát hiện bất thường, tối ưu lưu lượng, và ra quyết định tự động.

- Chuẩn hóa hệ sinh thái: Các tiêu chuẩn lập trình DPU như NVIDIA DOCA sẽ được mở rộng, tạo điều kiện phát triển một cộng đồng đa dạng các nhà phát triển và giải pháp phần mềm.

- Phát triển ra Edge Computing: DPU nhỏ gọn, tiết kiệm năng lượng sẽ xuất hiện ở thiết bị biên, giúp xử lý dữ liệu tại chỗ, giảm độ trễ và tải mạng.

- Hỗ trợ điện toán lượng tử: DPU tương lai có thể xử lý và tối ưu dữ liệu đầu vào cho hệ thống lượng tử, đóng vai trò cầu nối giữa hệ thống cổ điển và lượng tử.

- Xanh hóa trung tâm dữ liệu: Nhờ khả năng tối ưu lưu lượng và tiêu thụ điện thấp, DPU góp phần giảm năng lượng và khí thải trong hạ tầng số.

- Tăng cường bảo mật: DPU sẽ tích hợp nhiều lớp bảo mật tiên tiến như mã hóa đầu cuối và phát hiện hành vi bất thường, trở thành lớp bảo vệ chính trước các mối đe dọa mạng.

6. Câu hỏi thường gặp về DPU của NVIDIA

6.1 DPU khác gì so với GPU?

GPU được thiết kế cho xử lý đồ họa và tính toán song song, phù hợp với AI và hiển thị hình ảnh. Trong khi đó, DPU xử lý dữ liệu mạng, bảo mật và lưu trữ – giúp tăng hiệu suất hạ tầng bằng cách giảm tải cho CPU. Ví dụ: GPU huấn luyện AI, còn DPU lo phần kết nối mạng, bảo mật và luồng dữ liệu.

6.2 DPU có tương thích với hệ thống hiện tại không?

DPU NVIDIA (như BlueField) dùng khe PCIe tiêu chuẩn, tương thích với máy chủ phổ biến và hỗ trợ nhiều hệ điều hành (Linux, Windows Server, VMware). DPU hoạt động tốt với công nghệ mạng như Ethernet, InfiniBand, RoCE… Cài đặt đơn giản, có đủ driver, firmware và SDK hỗ trợ triển khai hiệu quả.

6.3 Chi phí và lợi ích khi triển khai DPU

- Chi phí: khoảng $2,000–$3,000 mỗi DPU + chi phí triển khai & đào tạo.

- Lợi ích: tăng hiệu suất (giảm tải CPU, giảm độ trễ, tăng thông lượng), tiết kiệm chi phí vận hành (giảm số máy chủ, điện năng, không gian), tăng bảo mật và đáp ứng tuân thủ.

- ROI: hoàn vốn sau 12–18 tháng, có thể nhanh hơn với doanh nghiệp lớn.

6.4 DPU có thay thế thiết bị mạng truyền thống không?

DPU có thể thay thế một số chức năng như card mạng, tường lửa ảo, cân bằng tải phần mềm… nhưng không thể thay hoàn toàn switch, router vật lý. Giải pháp hiệu quả là dùng DPU để xử lý mạng ở cấp máy chủ, kết hợp thiết bị truyền thống để tối ưu toàn bộ hệ thống.

6.5 Làm sao để bắt đầu với DPU?

Đánh giá nhu cầu: xác định ứng dụng cần tăng hiệu suất hoặc bảo mật.

1. Chọn DPU phù hợp: BlueField-2, 2X hoặc 3 tùy mục tiêu.

2. Chuẩn bị phần cứng: máy chủ hỗ trợ PCIe, đủ nguồn điện & làm mát.

3. Cài phần mềm: tải SDK, driver từ NVIDIA, cài công cụ quản lý.

4. Đào tạo: học online, tham khảo tài liệu và cộng đồng hỗ trợ.

5. Thử nghiệm nhỏ: đo hiệu suất trước/sau khi triển khai.

6. Mở rộng: mở rộng triển khai dựa trên kết quả, tối ưu dần.

DPU của NVIDIA không chỉ là xu hướng, mà đang trở thành thành phần cốt lõi trong hạ tầng điện toán hiện đại. Với khả năng xử lý thông minh ngay tại tầng mạng, DPU giúp tối ưu hiệu suất, tăng cường bảo mật và mở rộng khả năng cho các hệ thống dữ liệu quy mô lớn. Đã đến lúc khám phá sâu hơn về công nghệ này.